-

学习时长

12周/建议每周至少6小时

-

答疑服务

专属微信答疑群/讲师助教均参与

-

作业批改

每章节设计作业/助教及时批改评优

-

课程有效期

一年/告别拖延,温故知新

- 第1章: 自动驾驶感知模型的演变

- 1: 【课件】感知模型的演变

- 第1节: 自动驾驶功能需求的变化

- 2: 【视频】章节内容介绍

- 第2节: L2与L2+的感知系统

- 3: 【视频】L2与L2+的感知系统

- 第3节: Telsa如何解决L2+感知需求

- 4: 【视频】Telsa如何解决L2+感知需求

- 第4节: 补充:self-attention与cross-attention

- 5-1: 【课件】Transformer中的self-attention与Cross-attention

- 5-2: 【视频】详细讲解Transformer中的Attention

- 5-3: 【视频】视觉Transformer中的self-attention与Cross-attention

- 第5节: 实践:ViT中的Attention

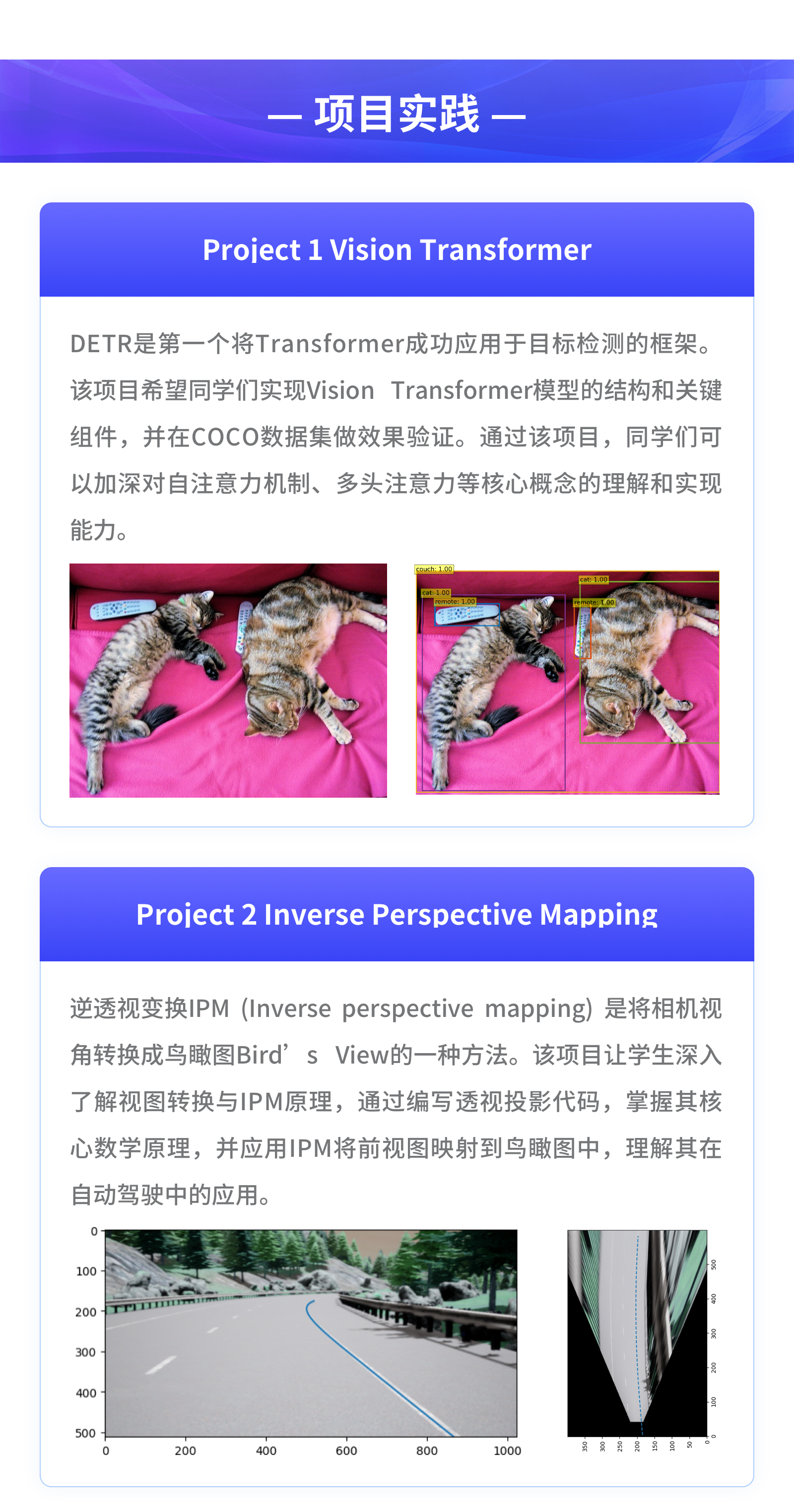

- 6-1: Project 1 Vision Transformer实践说明

- 6-2: 【实践】Project 1 Vision Transformer

- 6-3: 【作业】Project 1 Vision Transformer

- 6-4: Project 1 Vision Transformer作业思路讲解和问题汇总

- 第2章: 特征空间转换方法

- 7-1: 【课件】View Transformation

- 7-2: 【论文】前两章课件中涉及到的论文

- 第1节: 为什么BEV是更合适的特征空间

- 8: 【视频】为什么BEV是更合适的特征空间

- 第2节: LSS(2D to 3D/从底向上):基于深度分布估计的方法

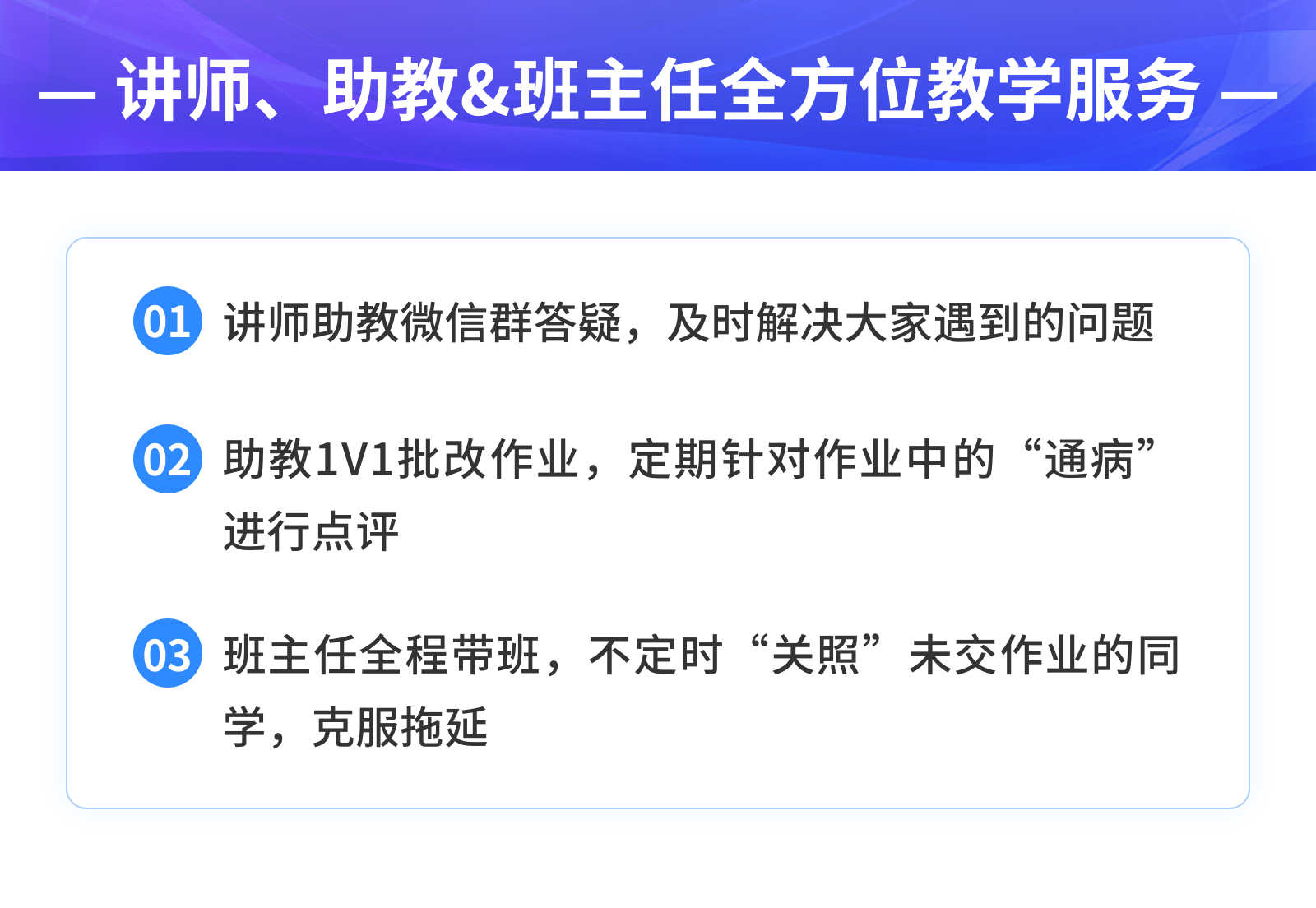

- 9: 【视频】IPM与LSS特征空间转换方法

- 第3节: Transformer(3D to 2D/从顶向下):基于注意力机制的方法

- 10-1: 【视频】Transformer特征空间转换方法

- 10-2: 【视频】本章小结

- 第4节: 实践:IPM特征空间变换

- 11-1: 【附件】Project2

- 11-2: 【作业】Project 2 IPM空间转换实践

- 11-3: 【文档】Project 2 IPM空间转换实践作业问题汇总

- 第5节: 实践:LSS特征空间变换

- 12-1: 【作业】Project3 LSS特征空间变换

- 12-2: 【文档】Project3作业思路提示

- 第6节: 实践:Transformer特征空间变换

- 13-1: 【作业】Project4 Transformer特征空间变换

- 13-2: 【文档】Project4作业思路提示

- 第3章: 基于LLS的BEV感知模型原理

- 14-1: BEV实践环境配置

- 14-2: 【课件】基于LSS的BEV模型原理

- 第1节: 内容引入

- 15: 【视频】内容引入

- 第2节: CaDNN算法

- 16: 【视频】CaDNN算法

- 第3节: BEVDet系列算法:BEVDet与BEVDet4D

- 17-1: 【视频】BEVDet系列算法:BEVDet原理与细节实现

- 17-2: 【视频】BEVDet系列算法:BEVDet4D基本思想

- 第4节: LSS-based 方法:M2BEV

- 18: 【视频】M^2BEV:第一个支持多任务的算法

- 第5节: LSS-based 方法:BEVFusion

- 19: 【视频】BEVFusion:图像与激光雷达融合的多传感器融合算法

- 第6节: LSS-based 方法:FastBEV

- 20: 【视频】面向工程设计的FastBEV

- 第7节: LSS系列算法小结

- 21: 【视频】LSS系列方法小结

- 第4章: LSS-based BEV感知模型的工程实现

- 22: 【课件】BEV模型实现讲解与实践 Part I

- 第1节: 内容概览:从感知任务需求到工程实现

- 23: 【视频】BEV工程实现:数据流、框架流、模型流与张量流

- 第2节: 从BEV感知任务到数据拆解:数据“流”

- 24-1: 【视频】数据“流”:标注数据-数据转换-数据训练

- 24-2: 【视频】数据“流”:标注数据

- 24-3: 【视频】数据“流”:数据转换

- 24-4: 【视频】数据“流”:数据集的准备与读取

- 第3节: 从BEV工程实现到框架拆解:框架“流”

- 25-1: 【视频】框架“流”:训练pipeline

- 25-2: 【视频】框架“流”:configs文件

- 25-3: 【视频】框架“流”:模型的Registry&Hook

- 25-4: 【视频】框架“流”小结

- 第4节: 从BEV算法设计到模型拆解:模型“流”与张量“流”

- 26-1: 【课件】模型流与张量流

- 26-2: 【视频】模型“流”&张量“流”:算法设计-模型封装实现-模型推理张量

- 26-3: 【视频】模型“流”&张量“流”:image-view encoder

- 26-4: 【视频】LSS-view transform

- 26-5: 【视频】BEV空间特征及任务head

- 第5章: LSS-based BEV感知模型在地平线征程芯片上的部署

- 27-1: 【课件】基于征程芯片的BEV算法部署:BEVDet为例

- 27-2: 【课件】BEVDet环境配置与实践

- 第1节: OpenExplorer开发包介绍

- 28: 【视频】OpenExplorer开发包介绍

- 第2节: 搭建浮点模型

- 29: 【视频】搭建浮点模型

- 第3节: 模型量化

- 30: 【视频】模型量化

- 第4节: 模型编译与上板

- 31: 【视频】模型编译与上板

- 第6章: 基于Transformer的BEV模型原理

- 32: 【课件】基于Transformer的BEV模型原理

- 第1节: Transformer-based方法的引入

- 33: 【视频】Transformer-based方法的引入

- 34-1: 【视频】基于稠密Query的BEV表示:BEVFormer

- 34-2: 【视频】BEVFormer的实现细节

- 35: 【视频】基于稀疏Query的BEV表示:PETR系列

- 36: 【视频】基于稀疏Query的BEV表示:FUTR3D

- 第2节: View Transformation各类方法的总结

- 37: 【视频】BEV动静态元素检测任务模型总结

- 第7章: 基于Transformer的BEV感知模型的工程实现

- 38: 【课件】BEVFormer模型实现讲解与实践

- 第1节: 内容概览:从算法设计到模型推理张量

- 39: 【视频】内容概览

- 第2节: Transformer-based 3D-to-2D的实现思路

- 40: 【视频】Transformer-based 3D-to-2D 基本思路

- 第3节: BEVFormer的数据流

- 41: 【视频】BEVFormer的数据流

- 第4节: BEVFormer的模型封装

- 42: 【视频】BEVFormer的模型封装实现

- 第5节: BEVFormer Encoder的实现

- 43-1: 【视频】BEVFormerEncoder:TemporalSelfAttention(上)

- 43-2: 【视频】BEVFormerEncoder:TemporalSelfAttention(下)

- 43-3: 【视频】SpatialCrossAttention

- 第6节: Detection Transformer Decoder的实现

- 44: 【视频】DetectionTransformerDecoder

- 第7节: 实践:图像与点云BEV空间特征融合实践

- 45-1: 【任务说明】图像与点云BEV空间特征融合实践

- 45-2: 【实践】图像与点云BEV空间特征融合

- 45-3: 【选做作业】Final Project 图像与点云BEV空间特征融合实践

- 第8章: Transformer-based BEV模型在Nvidia芯片上的部署

- 第1节: 基于Nvidia芯片的BEVFormer推理加速

- 46-1: 【视频】训练好的模型转ONNX

- 46-2: 【视频】ONNX转TensorRT模型

- 第9章: BEV for Occupancy

- 47: 【课件】从BEV到Occupancy

- 第1节: 任务定义

- 48: 【视频】任务定义

- 第2节: Occupancy方法:MonoScene, VoxFormer, TPVFormer,OpenOccupancy, SurroundOcc, Occ3D

- 49: 【视频】MonoScene

- 50: 【视频】VoxFormer

- 51: 【视频】TPVFormer

- 52: 【视频】OpenOccupancy

- 53: 【视频】SurroundOcc

- 54: 【视频】Occ3D

- 第3节: 总结

- 55: 【视频】总结

- 第10章: BEV for Mapless

- 第1节: 高精地图介绍

- 56: 【视频】高精度地图介绍

- 第2节: HDMapNet:在BEV空间上做⽮量地图元素检测

- 57: 【视频】HDMapNet感知局部矢量地图

- 第3节: STSU:用贝塞尔曲线表达矢量地图

- 58: 【视频】STSU:贝塞尔曲线表达矢量地图

- 第4节: VectorMapNet:用Polyline与点集构建矢量地图

- 59: 【视频】VectorMapNet:用Polyline与点集构建矢量地图

- 第5节: MapTR:更接近量产落地的方案

- 60: 【视频】MapTR:更接近量产落地的方案

- 第6节: Mapless方法总结

- 61: 【视频】Mapless方法总结

- 第11章: BEV for End-to-End

- 62: 【课件】从BEV到End to End

- 63: 【视频】从BEV到End-to-End

- 第1节: FIERY:Perception + Prediction

- 64: 【视频】从BEV到E2E:FIERY

- 第2节: MUTR3D:Perception + Tracking

- 65: 【视频】从BEV到E2E:MUTR3D

- 第3节: UniAD:Perception + Planning

- 66: 【视频】从BEV到E2E:UniAD

- 第12章: 自动驾驶中的4D标注

- 67: 【课件】自动驾驶中的4D Label概述

- 第1节: 4D Label背景介绍

- 68: 【视频】4D Label背景介绍

- 第2节: 4DLabel在自动驾驶中的作用

- 69: 【视频】4DLabel在自动驾驶中的作用

- 第3节: 自动驾驶中的数据问题

- 70: 【视频】自动驾驶中的数据问题